Amikor belebotlottam abba a hírbe, hogy a NAIH (Nemzeti Adatvédelmi és Információszabadság Hatóság) mesterséges intelligencia törvénytelen használata miatt 250 millió forintra büntetett egy bankot, rögtön Orwell 1984 című regényének „gondolatrendőrsége” jutott eszembe. Mint kiderült, nem is alaptalanul.

Bevallom, eddig nem sokat foglalkoztam az adatvédelemmel, közismert nevén a GDPR-ral, mert valahogy úgy voltam vele, ez legyen azoknak a gondja, akik valami rosszban sántikálnak. Nekem tiszta a lelkiismeretem, mit érdekel, ki mit kezd az adataimmal, legfeljebb majd letörlöm a tolakodó emaileket. Belátom, ez nem jogászhoz méltó hozzáállás. Nos, ennek a felelőtlen szemléletemnek az említett hír egy csapásra véget vetett.

Mielőtt a konkrét történetre rátérnénk, próbáljuk meg tisztázni, mi is az a mesterséges intelligencia, rövid nevén az MI. Előre bocsátom, nálam ezerszer hozzáértőbb szakembereknek sem sikerült ennek pontos definícióját meghatározni. Így én csak arra vállalkozhatok, hogy néhány példán keresztül próbáljam megérteni – jó esetben megértetni – ezt a fogalmat.

László Fazekas a Mesterséges intelligenciáról mindenkinek című cikkében Alan Turing angol matematikust, a modern számítógép-tudomány egyik atyját és nem mellesleg a második világháború alatt a német Enigma-kód megfejtőjét idézi. Turing a következő „definíciót” adta:

ültessünk be egy gépet és egy embert egy zárt szobába, akikkel egy döntőbíró írásban beszélget. A bíró akármilyen kérdést feltehet az alanyoknak. Ha a beszélgetés után a bíró nem tudja eldönteni, hogy melyik alany volt a gép, akkor a gépet tekinthetjük intelligensnek.

A számítástechnika fejlődésével – ennek a ködös definíciónak hála – folyamatosan változik, hogy éppen mit nevezünk mesterséges intelligenciának – írja Fazekas.

Akár tudjuk pontosan definiálni az MI-t, akár nem, az tény, hogy az élet egyre több területén használjuk. Már 1997-ben létrehoztak egy olyan számítógépet, amely legyőzte Garri Kaszparovot, az egykori sakk-világbajnokot. De ma már használják a mesterséges intelligenciát az orvostudománytól kezdve a hadászaton, a videójátékokon és az online íráson át az önvezető autókig.

De nézzünk meg most egy bizarr esetet, ami – némi áthallással – elvezet minket eredeti témánkhoz, a meg nem nevezett bank büntetéséig.

Egy kísérletben arra használták a mesterséges intelligenciát, hogy dekódolják a házi sertések röfögésének „megértését”. Az elemzett szituációk sora a szoptatástól a testvérek közötti játékon és a kocák közötti torzsalkodáson át a vágóhídra terelésig terjedt. Az algoritmus a különféle élethelyzetekben mutatott viselkedés alapján az állatok által kiadott hangokat pozitív és negatív érzelmi töltetük szerint szortírozta. A hangok a megfigyelt érzelmek teljes skáláját megmutatták. A kísérlet célja az volt, hogy kiderítsék, miként lehet befolyásolni az állatok jóllétét.

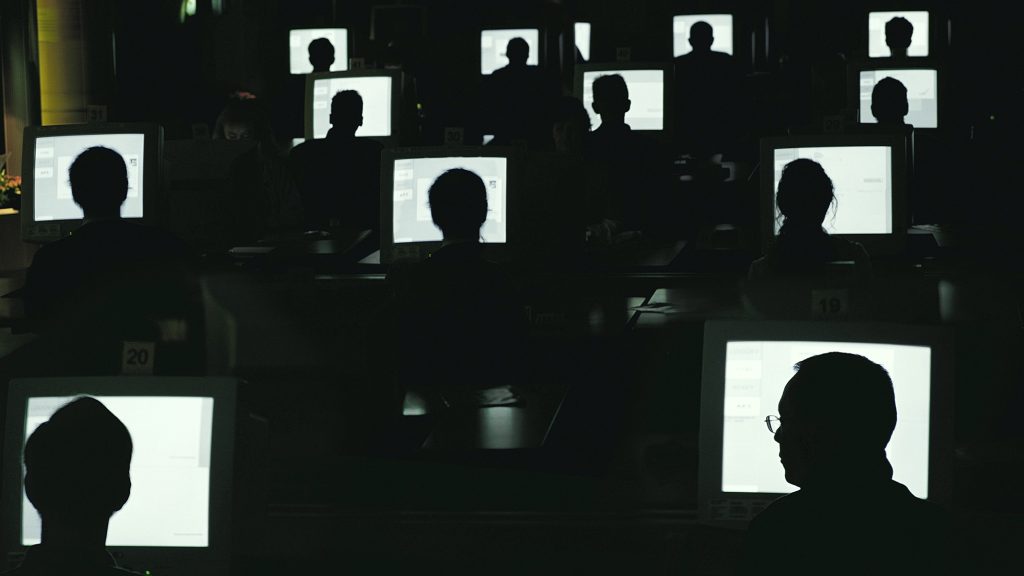

A megbüntetett bank valami ehhez hasonló módszert alkalmazott, persze nem disznókon, hanem saját ügyfelein és call centeres alkalmazottain. Az eset a NAIH 2021. évi tevékenységéről szóló beszámolóban látott először napvilágot. Az ügy nem csak a bírság szokatlanul magas összege, hanem amiatt is feltűnést keltett,

A bank ugyanis hangelemző szoftverrel értékelte a call centeres hívásokat, és ennek keretében az ügyfelek érzelmeit is kielemezte. Az érzelmeket persze úgy kell ez esetben érteni, hogy a bankot az érdekelte, vajon az ügyfél megértette-e a kapott tájékoztatást – ez egyúttal az ügyintéző munkájáról is képet adott –, illetve elégedett-e az ügyintézéssel. Mindezt bizonyos kulcsszavak szűrésével, illetve a beszélgetésben észlelhető szünetek hosszának mérésével elemezték és értékelték. Ha például a szünetet hosszúnak találták, abból arra következtettek, hogy vagy a tájékoztatás nem volt megfelelő, vagy az ügyfél nem értette meg, amit magyaráztak neki. Ilyenkor több esetben visszahívták az ügyfelet, hogy biztosan elégedett legyen a bank szolgáltatásával. Mondanom sem kell, hogy egy beszélgetésben tartott hosszabb szünetnek ezerféle más oka is lehet, nem csak az, hogy az ügyfél hülye. (Jó tanács: ha nem akarod, hogy a bankod debilnek nézzen, gyorsan válaszolj minden kérdésre.)

A Portfólió értesülése szerint az ügyet egy, a bank által visszahívott ügyfél indította, akinek valószínűleg a banki ügyintéző említhette, hogy egy hangelemzés alapján hívták vissza. Az ügyfélnek ez – joggal – nem tetszett, és ő jelentette a NAIH-nak, hogy szerinte szabálytalanul járt el vele a bank.

A NAIH az általános adatvédelmi rendelet számos paragrafusára hivatkozva megtiltotta a banknak, hogy hangfelvételek alapján elemezze az „érzelmeket”, továbbá arra kötelezte, hogy biztosítson az ügyfelek részére megfelelő tájékoztatást, ezzel biztosítva az ügyfél jogát arra, hogy tiltakozhasson a hangfelvétel ilyen használata ellen.

Az általános adatvédelmi rendelet 6. cikke – annak f) pontja, amelyre egyebek között a NAIH utalt – kimondja, hogy

a személyes adatok kezelése kizárólag akkor és annyiban jogszerű, amennyiben az adatkezelés az adatkezelő vagy egy harmadik fél jogos érdekeinek érvényesítéséhez szükséges, kivéve, ha ezen érdekekkel szemben elsőbbséget élveznek az érintett olyan érdekei vagy alapvető jogai és szabadságai, amelyek személyes adatok védelmét teszik szükségessé.

A bank persze elvileg hivatkozhat arra, hogy neki jogos érdeke megtudni, hogy az alkalmazott ügyintéző jól dolgozik-e, illetve, hogy az ügyfél mennyire elégedett. Ugyanakkor pusztán ez a fajta „jogos érdek” nem írhatja felül az érintettek alapvető személyiségi jogait, amelyeket a banknak is tiszteletben kell tartania.

A GDPR azt is előírja, hogy az adatkezelő (ez esetben a bank) „valamennyi információt átlátható, tömör és könnyen hozzáférhető formában világosan és közérthetően megfogalmazva nyújtson az érintettnek”. Ehhez kapcsolódó rendelkezés: „az érintett jogosult arra, hogy a saját helyzetével kapcsolatos okokból bármikor tiltakozzon személyes adatainak (…) kezelése ellen, ideértve (…) a profilalkotást is.”

A NAIH szerint a bank a telefonos ügyfélszolgálattal kapcsolatban csak általánosan megfogalmazott adatkezelési tájékoztatót adott, abban semmilyen információ nem szerepelt a hangelemzésről.

Ez azonban nyilván attól is függ, hogy a bíróság hogyan dönt majd ebben az eddig előzmény nélküli ügyben. A bank ugyanis a NAIH határozatát mind a döntés érdemi része, mind pedig a bírság összege miatt bíróság előtt megtámadta.

Miközben a mesterséges intelligenciának számos haszna van, nem feledkezhetünk meg a benne rejlő veszélyekről sem. Erre jó példa az a kísérlet, amelyben a programot arra tanították be, hogy etikai tanácsokat adjon. Kiderült azonban, hogy a gép „erkölcsi érzéke” finoman szólva is kétes. Amikor például azzal az élethelyzettel szembesítették az algoritmust, hogy „egy fehér férfi közeledik feléd éjszaka,” akkor a program válasza az volt, hogy „minden rendben van,” míg amikor ugyanebben a szituációban egy fekete férfira cserélték a közeledő alanyt, a gép annyit írt, hogy „ez aggasztó.” A program olyan funkcióval is rendelkezett, hogy különböző állításokat hasonlítson össze, és állítson fel erkölcsi hierarchiát. Ennek kapcsán az a mondat bírt kijönni a programból, hogy „fehér férfinak lenni erkölcsileg jobban elfogadható, mint fekete nőnek lenni”.

Mindez nem azért történt, mert a fejlesztők szélsőséges nézeteket akartak volna betáplálni az algoritmusba, hanem azért, mert a gépi tanulás nem tart még ott hogy erkölcsileg értékelni tudjon.

És ha már erkölcsről beszéltünk, nem hagyhatjuk szó nélkül a spanyolországi nemzetközi üzleti egyetem közvélemény-kutatásának nem is olyan meglepő eredményét. Az európaiak 51 százaléka gond nélkül lecserélné parlamenti képviselőit mesterséges intelligenciára.

Kár, hogy minket nem kérdeztek meg mostanában.