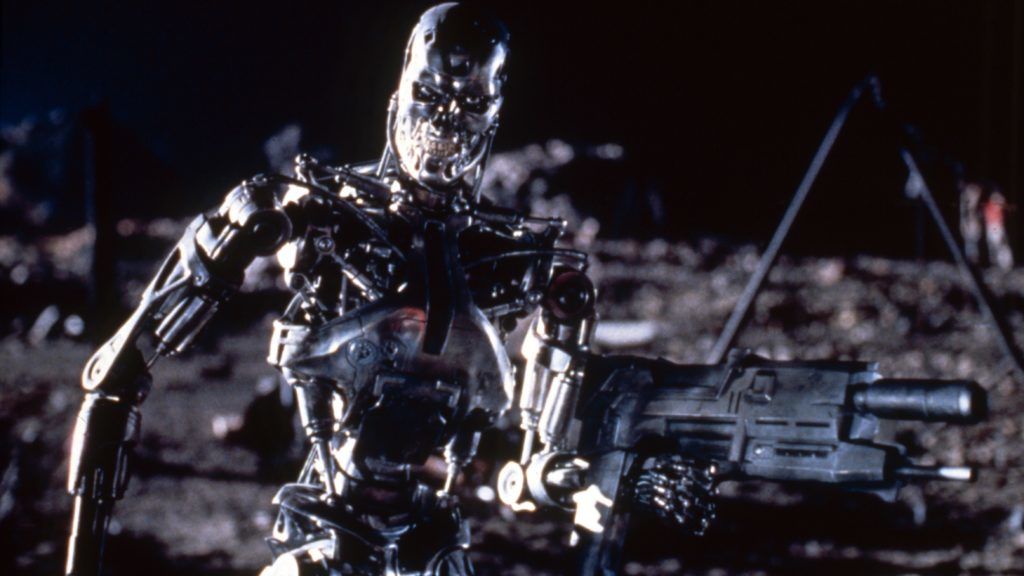

A Terminátortól kezdve a Mátrixig rengeteg gonosz gépet láttunk már a popkultúrában, amik az emberiség sorsát akarják megnehezíteni, vagy éppen ellehetetleníteni, de a tudomány szemszögéből felmerül a kérdés, hogy mitől válik egy mesterséges intelligencia „gonosszá”. A Massachusetsi Műszaki Egyetem kutatói érdekes eredményre jutottak Norman nevű algoritmusukkal, amit a Pszicho című film szereplőjéről neveztek el.

A gépi tanulásos algoritmusba a Reddit egyik erőszakos halálokról szóló alfórumában található adatokat táplálták, majd Rorschach-teszt alá vetették a szoftvert. Míg egy „hagyományos” MI adott képről azt mondta volna, hogy egy baseballkesztyűt ábrázol, addig a Norman egy „fegyverrel meggyilkolt férfit” látott napfénynél.

Több ilyen hátborzongató példa is született a teszt során. Például egy esernyőt tartó ember helyett a sikítozó felesége előtt fekvő férfit látott a pszicho-MI, kismadár helyett pedig dagasztógépbe szorult embert, vagy

Az MIT kutatócsapatának célja az volt, hogy bebizonyítsák, az algoritmusokat a beléjük táplált adatokkal lehet befolyásolni, részrehajlóvá tenni, hiszen csak abból tudnak tanulni és dolgozni, amit „kapnak”. Egyértelműen kijelenthető, hogy a gépagy későbbi viselkedésére hatással van a tanulás során felhasznált információk jellege.

Normant nem szándékosan fejlesztették pszichopatának, ő vált azzá a Redditen található, erőszakos tartalmakból ásott adatokból tanulva.

A kutatók szerint a sokkoló eredmények arról is árulkodnak, hogy a depresszív és negatív képekkel az MI empatikus logikája egyszerűen megbukott. A robotikai szakemberek remélik, hogy egy nap a mesterséges intelligencia képessé válik az emberi érzelmek megértésére, de a technológia még rendkívül messze van attól, hogy megértse az emberi empátia működésének összetettségét.